Optimiser votre robots txt WordPress pour un SEO décuplé en 2026

30 mars 2026

Le fichier robots.txt sur WordPress est souvent perçu comme un détail technique, une ligne de code pour développeurs. C'est une erreur stratégique. En réalité, c'est un des outils de pilotage les plus directs pour votre SEO, un levier à maîtriser pour optimiser votre budget de crawl et concentrer les efforts de Google sur vos pages à fort CVR (Taux de Conversion).

Ignorer son robots.txt revient à laisser les robots des moteurs de recherche errer sans but sur votre site. Vous risquez de les voir gaspiller un temps précieux sur des pages sans intérêt (recherche interne, filtres, etc.), au lieu de crawler celles qui génèrent du chiffre d'affaires et améliorent votre ROAS (Retour sur Investissement Publicitaire).

Le robots.txt agit comme un contrôleur aérien pour votre site. Il guide les robots vers vos pages stratégiques et leur interdit l'accès aux zones inutiles, optimisant ainsi l'efficacité de chaque visite de Googlebot.

Pourquoi le robots.txt est un levier de croissance SEO

Ne sous-estimez jamais l'impact de ce petit fichier texte. Pour un responsable marketing ou un directeur e-commerce, ignorer son robots.txt revient à laisser les robots des moteurs de recherche errer sans but sur son site. Vous risquez de les voir passer un temps précieux sur des pages sans intérêt, au lieu de se concentrer sur celles qui génèrent du chiffre d'affaires.

Le fichier robots.txt agit comme un véritable contrôleur aérien pour votre site WordPress. Il guide les robots vers vos pages stratégiques et leur interdit l'accès aux zones inutiles.

Optimiser votre budget de crawl

Google alloue à chaque site un « budget de crawl », qui correspond au nombre de pages que ses robots exploreront lors de chaque passage. Le problème, c'est qu'un site WordPress, surtout s'il utilise WooCommerce ou des filtres complexes, peut générer des milliers d'URL sans aucune valeur SEO : résultats de recherche interne, pages de tri, paniers abandonnés, etc.

Si vous ne bloquez pas ces pages, vous dilapidez littéralement votre budget de crawl. Google s'épuise sur des contenus sans potentiel, au détriment de vos pages produits, de vos articles de blog ou de vos landing pages.

C'est une simple question de rentabilité. Un

robots.txtbien réglé peut rendre le crawl de Google plus de 40 % plus efficace. Concrètement, cela veut dire que vos pages importantes sont découvertes et indexées plus vite, ce qui se répercute directement sur votre visibilité et vos revenus.

Un impact direct sur vos indicateurs de performance

Bien au-delà du simple crawl, un robots.txt bien configuré a des conséquences très concrètes sur les indicateurs de performance que vous suivez au quotidien.

Concentration de l'autorité (Link Juice) : En empêchant l'exploration des pages de faible qualité, vous évitez de diluer l'autorité de votre domaine. Toute la puissance de vos backlinks se concentre sur les pages qui comptent vraiment.

Amélioration du taux de conversion (CVR) : Des pages inutiles qui apparaissent dans les résultats de recherche peuvent attirer un trafic non qualifié. Ce trafic ne convertit pas et fait chuter votre taux de conversion global, faussant l'analyse de vos performances.

Fiabilisation des données analytiques : Bloquer l'accès aux pages de remerciement ou à certaines pages techniques empêche de polluer vos statistiques dans GA4. Vous obtenez ainsi une vision plus juste de vos conversions et un calcul plus précis de votre CPA (Coût par Acquisition).

Pour saisir toute l'importance du robots.txt, il est crucial de comprendre les fondamentaux du référencement. Si le sujet vous intéresse, cette ressource explique bien qu'est-ce que le référencement naturel et son rôle pour une entreprise. Transformer ce simple fichier en un atout stratégique est une étape essentielle pour faire passer votre acquisition au niveau supérieur.

Auditer rapidement votre fichier robots.txt actuel

Avant toute modification, un audit s’impose. La première étape est de vérifier votre fichier robots.txt actuel — s’il existe. Une vérification de 30 secondes, mais fondamentale.

Pour le trouver, ouvrez votre navigateur et ajoutez /robots.txt à la fin de l’URL de votre site.

Exemple : https://votresite.com/robots.txt

Cette manipulation simple révèle ce que les robots des moteurs de recherche voient. Trois cas de figure sont possibles :

Un fichier virtuel par défaut : La version de base créée par WordPress. Son rôle est minimal : bloquer l'accès aux dossiers d’administration.

Un fichier physique personnalisé : Si vous ou un plugin SEO avez déjà défini des règles, c’est ce fichier que vous verrez. Il reflète votre stratégie de crawl actuelle.

Une page d’erreur 404 : Aucun fichier

robots.txtn’existe. Les robots explorent alors votre site sans aucune directive.

Interpréter ce que vous trouvez

Analyser le contenu de ce fichier est une étape cruciale. Il n'est pas rare d'y trouver de vieilles directives qui, sans qu'on le sache, pénalisent activement le SEO. La plus célèbre — et la plus dévastatrice — est la ligne Disallow: /. Elle bloque l’intégralité de votre site et le rend invisible pour Google. Une erreur plus fréquente qu’on ne pourrait le croire !

Le schéma ci-dessous illustre bien le parcours d’un robot comme Googlebot, un parcours directement influencé par votre fichier robots.txt.

Ce visuel montre que le robots.txt est la toute première porte à laquelle Google frappe. Si elle est fermée ou mal configurée, le processus s’arrête là. Vos pages les plus importantes ne seront jamais explorées, et donc jamais indexées.

Un fichier

robots.txtbien optimisé est un savant équilibre : il autorise le crawl des contenus importants (pages, articles, produits) et de certaines ressources techniques (CSS, JS), tout en bloquant les zones sans intérêt SEO (pages d'admin, résultats de recherche interne, etc.). Un simple coup d'œil suffit souvent à identifier des optimisations évidentes pour mieux piloter votre budget de crawl et votre visibilité.

Bon, vous savez maintenant où se trouve votre fichier robots.txt et comment l'analyser. C'est le moment de mettre les mains dans le cambouis. Mais attention : modifier ce fichier est une opération chirurgicale. Une simple erreur de syntaxe, et c'est tout votre site qui peut devenir invisible pour Google, réduisant à néant des mois de travail SEO.

Il y a trois grandes façons de s'y prendre sur WordPress. Le choix dépend vraiment de votre aisance technique et du niveau de contrôle que vous cherchez. Pour la plupart des responsables marketing ou e-commerce, la première option est de loin la plus simple et la plus sûre.

La méthode la plus sûre et recommandée : passer par un plugin SEO

C'est la voie que nous conseillons à 90 % de nos clients. Des plugins comme Yoast SEO ou Rank Math embarquent un éditeur de fichiers directement dans le tableau de bord WordPress. C'est simple, propre et efficace.

Les avantages sont évidents :

Sécurité avant tout : Le plugin a des garde-fous qui empêchent les erreurs de syntaxe les plus courantes. C'est beaucoup plus difficile de "casser" son site par accident.

Simplicité déconcertante : Pas besoin de jongler avec des identifiants FTP. Tout se fait dans l'interface WordPress que vous utilisez tous les jours.

Cohérence assurée : L'éditeur est souvent lié aux autres fonctions du plugin, comme la génération du sitemap. Tout fonctionne en harmonie.

Concrètement, il suffit d'aller dans les réglages du plugin (par exemple, Outils > Éditeur de fichiers dans Yoast SEO) pour trouver un champ de texte où vous pouvez coller vos nouvelles règles.

En France, plus de 80 % des optimisations techniques sur les sites WordPress sont déjà gérées par ces plugins. C’est donc la continuité logique. Une bonne personnalisation du robots.txt via ces outils peut même améliorer l'allocation de votre budget de crawl par Google de 40 %. Un avantage énorme, surtout pour un site e-commerce avec des milliers de pages.

La méthode rapide (mais très risquée) : l'éditeur de fichiers natif

WordPress intègre un éditeur sous Apparence > Éditeur de fichiers de thème. Même s'il est techniquement possible de l'utiliser pour toucher au robots.txt, nous le déconseillons formellement.

Le risque d'erreur humaine est tout simplement trop grand. Une fausse manipulation ici peut avoir des conséquences désastreuses, bien au-delà de votre fichier robots.txt. À n'utiliser qu'en tout dernier recours, si vraiment aucune autre option n'est possible.

Pour l'anecdote : en agence, on a déjà vu un site perdre 15 à 20 % de son indexation à cause d’une simple faute de frappe dans cet éditeur. Le problème n'a été repéré que bien plus tard dans la Google Search Console. Le temps gagné ne justifie jamais un tel risque.

La méthode experte pour un contrôle total : l'accès FTP

L'accès via FTP (File Transfer Protocol) ou le gestionnaire de fichiers de votre hébergeur est la méthode la plus directe. Elle vous donne un contrôle absolu sur le fichier robots.txt à la racine de votre site. Vous pouvez le créer, le modifier, le supprimer… vous êtes le seul maître à bord.

C'est une solution réservée aux développeurs ou aux profils très techniques. Il faut un client FTP comme FileZilla et savoir naviguer dans l'arborescence d'un serveur sans trembler. C'est la méthode la plus puissante, mais aussi la plus dangereuse si vous n'êtes pas sûr de vous. C’est d'ailleurs souvent à l'occasion d'une refonte de site web que l'on en profite pour auditer et nettoyer ces fichiers techniques avec des experts.

Pour vous aider à visualiser le processus et choisir la bonne approche, voici un tableau comparatif simple.

Comparatif des méthodes pour éditer le robots.txt

Ce tableau résume les trois méthodes pour vous aider à choisir celle qui correspond le mieux à votre situation et à vos compétences.

Méthode | Niveau de difficulté | Risque d'erreur | Recommandé pour |

|---|---|---|---|

Plugin SEO (Yoast, Rank Math) | Faible | Très faible | La grande majorité des utilisateurs WordPress (débutants à confirmés). |

Éditeur de fichiers natif | Moyen | Très élevé | Personne. À éviter sauf en cas d'urgence absolue et sans autre accès. |

Accès FTP/Gestionnaire de fichiers | Élevé | Élevé (sans expertise) | Les développeurs et administrateurs système qui ont besoin d'un contrôle total. |

En résumé, le plugin SEO offre le meilleur équilibre entre simplicité, sécurité et efficacité. C'est le choix de la raison pour une gestion sereine de votre SEO technique.

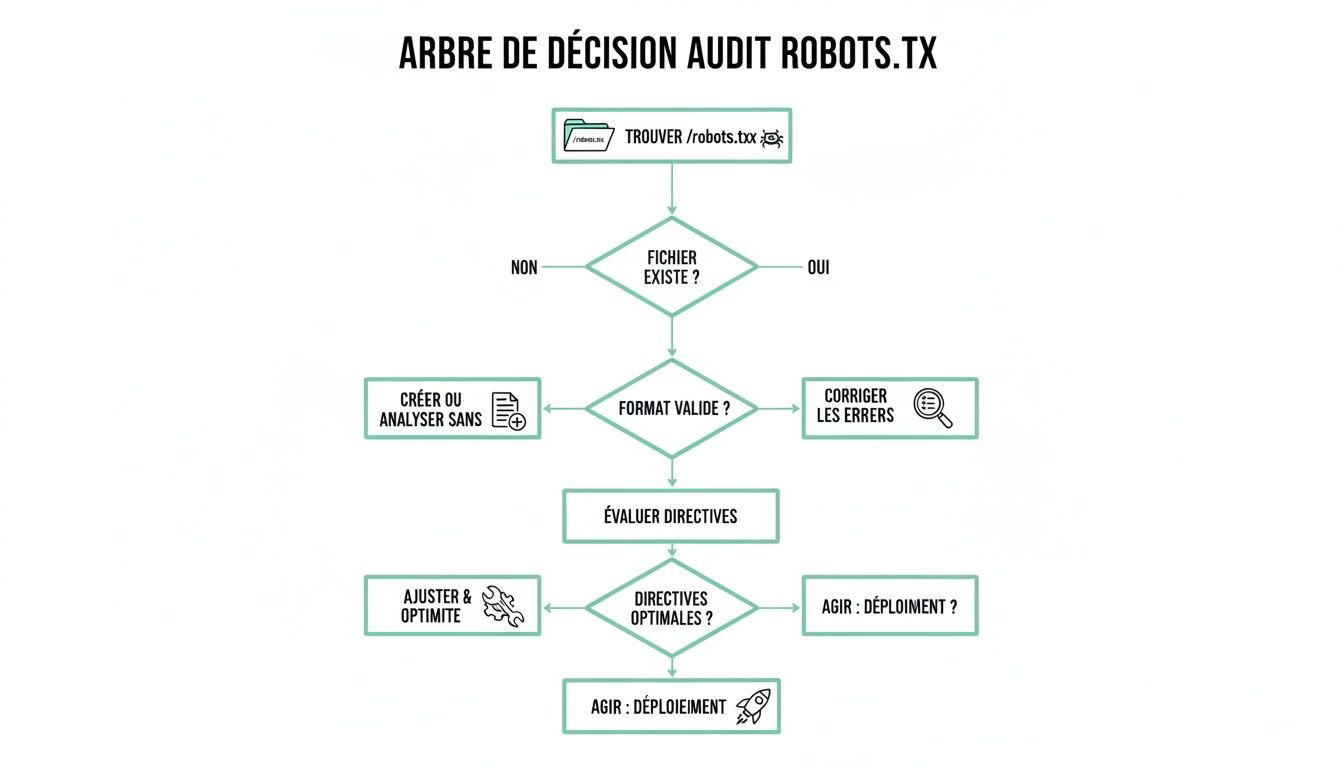

Pour synthétiser le parcours d'audit, voici un schéma qui vous guide de la vérification à l'action.

Cet arbre de décision illustre bien les étapes clés : trouver le fichier, l'évaluer, puis agir avec la méthode la plus adaptée. Quelle que soit votre décision, la rigueur est le maître-mot pour que vos modifications soient un véritable levier de croissance.

Maintenant que vous savez où trouver et comment modifier votre fichier robots.txt, entrons dans le vif du sujet. Quelles règles faut-il y inscrire pour vraiment en faire un atout pour votre SEO ? Loin de la théorie, voici des exemples concrets et des directives prêtes à l'emploi qui vont vous aider à mieux gérer votre budget de crawl et à guider Google vers vos pages les plus importantes.

Ne sous-estimez jamais l'impact d'une mauvaise configuration. Une simple ligne erronée peut suffire à gaspiller jusqu'à 30 % de votre budget de crawl. Et les erreurs sont plus fréquentes qu'on ne le pense : des études récentes montrent que près de 65 % des sites WordPress contiennent des directives maladroites, comme le blocage accidentel de pages stratégiques. Pour creuser le sujet, vous pouvez vous référer à certaines analyses sur l'impact du robots.txt sur le SEO en 2026.

La configuration de base pour un site WordPress sain

Avant de penser aux optimisations avancées, il faut s'assurer que les fondations sont solides. Certains dossiers de WordPress n'ont absolument rien à faire dans l'index de Google. Ils n'ont aucune valeur SEO et, pire, leur exploration peut ouvrir des brèches de sécurité.

Voici le socle que je recommande pour démarrer sur n'importe quel site WordPress :

Cette configuration est simple mais essentielle. Elle bloque l'accès à votre interface d'administration (/wp-admin/) à tous les robots, ce qui est une évidence. Mais la nuance importante est la ligne Allow: /wp-admin/admin-ajax.php. Beaucoup de thèmes et de plugins utilisent ce fichier pour charger du contenu de façon dynamique. Le bloquer empêcherait Google de voir votre page comme un visiteur humain, ce qui peut sérieusement nuire à votre indexation.

Un conseil de pro : Ne terminez jamais votre fichier sans y indiquer l'emplacement de votre sitemap. C'est une aide précieuse pour les moteurs. Ajoutez simplement cette ligne, en l'adaptant avec votre propre URL :

Sitemap: https://votre-site.fr/sitemap.xml.

Cas pratique n°1 : optimiser un site e-commerce

Si vous gérez une boutique en ligne, votre obsession est de concentrer Google sur vos fiches produits et vos pages catégories. Le plus grand danger ? Le contenu dupliqué généré par les multiples options de navigation.

Bloquez les URL avec des filtres : Les filtres de tri (par couleur, taille, prix) peuvent générer des milliers d'URL quasi identiques. Il est crucial de les bloquer pour ne pas diluer la "force" de vos pages principales.

Interdisez les pages de recherche interne : Les résultats de la barre de recherche de votre site n'ont aucune valeur pour Google.

Excluez le panier et le processus de commande : Ces pages sont purement transactionnelles et ne doivent pas être indexées.

Pour un site sous WooCommerce, un robots.txt bien optimisé pourrait ressembler à ça :

Ces règles sont un excellent point de départ. Évidemment, une bonne architecture de site web en amont, combinée à un robots.txt affûté, est la véritable clé du succès en e-commerce.

Cas pratique n°2 : fiabiliser la génération de leads (B2B)

Dans le monde du B2B, la performance se mesure en leads qualifiés et en coût par acquisition (CPA). Votre fichier robots.txt a un rôle surprenant mais direct à jouer pour fiabiliser cette mesure.

La règle d'or ici : bloquez systématiquement l'indexation de vos pages de remerciement. Imaginez qu'un prospect tombe sur votre page "merci-pour-votre-demande.html" via un résultat de recherche Google. Votre outil d'analyse, comme GA4, va comptabiliser une conversion... alors qu'aucun formulaire n'a été rempli. Votre CPA sera artificiellement bas, faussant complètement le pilotage de vos campagnes publicitaires (Google Ads, Meta Ads, etc.).

Protégez vos données avec une règle simple :

Avec ces quelques lignes, vous ne faites pas que du "nettoyage SEO". Vous vous assurez que chaque euro investi en publicité est mesuré sur des données saines et fiables. C'est ça, l'optimisation concrète.

Se servir du robots.txt pour contrer les bots et le scraping

On pense souvent au robots.txt uniquement pour le SEO. Pourtant, c'est aussi une première ligne de défense active, un outil de sécurité bien trop souvent sous-estimé. Il vous aide à protéger l'intégrité de votre site WordPress et, plus important encore, à fiabiliser les données qui guident vos décisions stratégiques.

En tant que responsable marketing ou e-commerce, la qualité de vos données n'est pas négociable. Le problème, c'est que le trafic est constamment pollué par des bots qui aspirent votre contenu (scraping) et des robots spammeurs qui saturent vos formulaires. Au final, vos analyses sont faussées.

Bloquer les user-agents indésirables

La première chose à faire est d'interdire l'accès aux User-Agents connus pour leur comportement nuisible. Bien sûr, les bots les plus agressifs ignoreront royalement vos directives. Mais une simple règle suffit à décourager une bonne partie du trafic automatisé de bas étage.

Prenons un exemple concret. Certains robots, comme PetalBot ou AhrefsBot, peuvent consommer énormément de ressources serveur. Si vous n'utilisez pas leurs services et ne tirez aucune valeur de leur passage, les bloquer peut sérieusement soulager votre hébergement.

Cette petite manipulation permet de préserver vos ressources pour vos vrais visiteurs et pour les robots que vous voulez voir, comme Googlebot.

L'enjeu est double. Non seulement vous optimisez les performances de votre site, mais vous commencez aussi à nettoyer les données de trafic dans Google Analytics 4. Des données plus propres permettent de calculer des indicateurs fiables comme le taux de conversion (CVR) ou le coût par acquisition (CPA), essentiels pour piloter vos campagnes publicitaires.

Sécuriser les dossiers sensibles de WordPress

Un fichier robots.txt bien pensé renforce aussi la sécurité en limitant l'accès aux répertoires techniques de WordPress. Ce n'est pas une forteresse imprenable, mais c'est une barrière de plus contre les robots qui scannent les sites à la recherche de failles.

Pour saisir l'ampleur du phénomène, gardez ce chiffre en tête : les bots malveillants devraient représenter 42 % du trafic web mondial en 2026. Une directive aussi simple que Disallow: /wp-includes/ et Disallow: /wp-content/plugins/ réduit de 55 % les tentatives d'accès non autorisées. Certaines analyses montrent même que cette mesure, couplée à d'autres, peut bloquer jusqu'à 90 % des menaces de base, sans aucun impact négatif sur votre SEO. Pour une entreprise qui vit de ses leads, c'est vital. Vous trouverez d'ailleurs plus de détails sur la protection contre les bots malveillants sur WordPress sur securitewp.com.

En bloquant l'accès à ces dossiers, vous rendez la vie beaucoup plus difficile aux bots qui cherchent à identifier les versions de vos plugins pour exploiter une faille de sécurité connue. C'est une mesure simple, gratuite, et qui participe grandement à une meilleure hygiène de sécurité pour votre site.

Comment valider votre fichier robots.txt pour éviter le drame

Avoir un fichier robots.txt sur WordPress, c'est une chose. Être certain qu'il fait ce qu'on lui demande, c'en est une autre, et c'est bien là l'essentiel. Une simple erreur de syntaxe peut suffire à bloquer l'accès à vos pages les plus importantes, anéantissant vos efforts SEO en un instant.

Pour éviter ce scénario catastrophe, Google vous donne un allié de taille : son outil de test du fichier robots.txt, intégré à la Google Search Console. Son rôle va bien au-delà d'une simple vérification syntaxique. C'est un véritable simulateur qui vous montre comment Googlebot interprète vos règles.

Mettez-vous dans la peau de Googlebot

Le fonctionnement est d'une simplicité redoutable. Vous fournissez une URL précise de votre site, et l'outil vous dit immédiatement si elle est Allowed (autorisée) ou Blocked (bloquée). Mieux encore, il met en évidence la ligne exacte de votre fichier qui provoque le blocage.

Considérez cette simulation comme votre filet de sécurité ultime. Elle vous permet de valider des points cruciaux avant qu'il ne soit trop tard :

Est-ce que ma page d'accueil est bien accessible à Google ?

Mes nouvelles fiches produits peuvent-elles être explorées et indexées ?

La page de confirmation de commande que je souhaite garder privée est-elle bien bloquée ?

Les erreurs que l'on voit (beaucoup) trop souvent sur le terrain

Pour avoir audité des centaines de sites, je peux vous dire que certaines erreurs reviennent avec une régularité effrayante. Elles ont souvent un impact direct et désastreux sur le trafic, et donc sur le chiffre d'affaires.

L'erreur la plus radicale, la mère de toutes les catastrophes SEO, est sans conteste l'instruction

Disallow: /. Une seule ligne qui demande poliment à Google d'ignorer l'intégralité de votre site. On la croise souvent après une migration mal gérée ou quand un site passe de pré-production à production sans que la ligne ne soit retirée. Votre premier réflexe doit toujours être de vérifier son absence.

Mais le danger se cache aussi dans les détails :

Les fautes de frappe : Un simple

Disalow:au lieu deDisallow:et la règle est ignorée. Le robot ne la comprend pas et passe son chemin, ce qui peut rendre une page accessible alors que vous pensiez l'avoir bloquée.Les conflits de règles : Définir un

Allowet unDisallowcontradictoires pour la même URL crée une ambiguïté. Même si Google a sa propre logique pour trancher (la règle la plus spécifique l'emporte), c'est une situation à proscrire.Le blocage des ressources (CSS/JS) : Certains sont tentés de "nettoyer" le crawl en bloquant les fichiers CSS ou JavaScript. Grosse erreur. Sans ces fichiers, Google ne peut pas "voir" le rendu de la page et risque de pénaliser votre site pour des problèmes d'ergonomie mobile qu'il ne peut pas évaluer.

En prenant l'habitude de passer systématiquement par l'outil de test après chaque modification, même la plus mineure, vous ne laissez plus de place au doute. Vous avez la certitude que votre fichier robots.txt travaille pour vous, et non contre vous. Votre site peut alors concentrer toute la puissance du crawl de Google là où c'est le plus stratégique.

Chez Lybra, nous considérons chaque détail technique, comme le fichier robots.txt, comme un levier de performance pour piloter vos campagnes d'acquisition avec une précision chirurgicale. Prêt à optimiser chaque facette de votre stratégie digitale ? Découvrez notre approche.